Ein Paket kommt zu spät. Der Kunde meldet sich. Was folgt, ist kein Gespräch mit einem Menschen – sondern ein Ablauf, den ein System eigenständig koordiniert: Sendungsstatus prüfen, lokale Filialverfügbarkeit checken, Express-Ersatzlieferung initiieren, Kunden informieren.

Alles autonom. Innerhalb von Sekunden. Und: innerhalb definierter Leitplanken.

Dieses Beispiel beschreibt keine Zukunft. Rainer Holler, CEO des deutschen CX-Technologieanbieters VIER, nutzt es, um zu erklären, wo Agentic AI im Kundenkontakt heute steht: Systeme, die übergeordnete Ziele verstehen und eigenständig handeln – aber nicht grenzenlos.

Genau in diesem „aber nicht grenzenlos“ liegt die eigentliche Managementaufgabe.

Was sich verändert hat – und warum es diesmal anders ist

Harald Henn, Herausgeber des CEX Trendradar und seit mehr als 20 Jahren einer der praxisnächsten CX-Beobachter im deutschsprachigen Raum, bringt es auf den Punkt: „Die Frage ist nicht mehr, ob AI eingesetzt werden soll, sondern wie.“ Das Wie entscheidet darüber, ob Automatisierung Vertrauen aufbaut oder abbaut.

Agentic AI – Systeme, die nicht nur antworten, sondern mehrstufig planen, entscheiden und handeln – ist 2025/2026 aus der Pilotphase herausgetreten. Gartner prognostiziert, dass bis 2029 bis zu 80 Prozent der gängigen Kundenservice-Anfragen autonom gelöst werden. Erste Praxisberichte aus DACH zeigen, dass bei klar definierten Standardanfragen bereits 60 bis 70 Prozent vollständig automatisiert abgewickelt werden können – gegenüber 20 bis 30 Prozent mit klassischen regelbasierten Systemen.

Das ist ein Paradigmenwechsel. Und er kommt mit einer Frage, die technisch nicht beantwortbar ist.

Das Problem ist nicht die Technologie

Anfang 2025 veröffentlichten Forscher von Hugging Face ein Papier mit einem programmatischen Titel: „Fully Autonomous AI Agents Should Not Be Developed.“ Das Papier liefert eine präzise Analyse eines Risikopfads – und einen ausgewogenen Kontrapunkt zu den damals grassierenden Hype-Narrativen rund um autonome Agenten.

Die Kernthese: Mit jeder Stufe steigender Autonomie nehmen auch die Risiken zu. Auf niedrigen Stufen schlägt KI Maßnahmen vor, die Menschen genehmigen müssen. Auf höheren Stufen führen Agenten mehrstufige Pläne eigenständig aus – in Multi-Agenten-Systemen, über Systemgrenzen hinweg. Im Extremfall geben Menschen jegliche Aufsicht auf. Die Frage ist nicht, ob das technisch möglich ist. Die Frage ist, ob die Vorteile die Risiken für Datenschutz, Sicherheit und Ethik aufwiegen.

Die Forscher kommen zu einer klaren Einschätzung: Vollständige Autonomie ohne bewährte Kontrollmechanismen tut das nicht. Die Entscheidung über den richtigen Autonomiegrad ist eine unternehmerische Designentscheidung. Sie gehört in die Hände von CX-Verantwortlichen.

Automatisierungsverzerrung: der blinde Fleck

Eine weitere Warnung kommt aus der Forschung. Studien der Stanford University zur Mensch-KI-Interaktion zeigen ein konsistentes Muster: Automatisierungsverzerrung – Menschen tendieren dazu, KI-Ergebnissen zu vertrauen, auch dann, wenn sie nachweislich falsch sind.

In CX-Kontexten ist das sehr konkret: Ein Agent, der eine falsche Kulanzentscheidung trifft, wird von Mitarbeitenden selten korrigiert, weil „das System es so vorgeschlagen hat.“ Gut gestaltete Systeme tragen dem Rechnung: Sie automatisieren, wo sie sich sicher sind, halten inne bei Unsicherheit, und holen menschliches Feedback strukturell ein – als eingebautes Prinzip, nicht als nachträgliche Korrektur. Das macht den Unterschied zwischen Systemen, die Verantwortung tragen, und solchen, die sie verwalten.

Guardrails: Wer zieht die Linie?

Rainer Holler (CEO von VIER) beschreibt den Kern funktionierender Agentic-AI-Implementierungen in drei Fragen: Welche Entscheidungen darf der AI Agent treffen? Bis zu welchem Betrag kann er autorisieren? Was muss zwingend an einen Mitarbeiter eskaliert werden?

Diese drei Fragen bilden die Governance-Grundlage. Und in den meisten Organisationen werden sie nicht explizit beantwortet – sie entstehen implizit, durch Vendor-Defaults und Pilotprojekte, die in Produktion überführt werden, ohne dass jemand die Grenzen neu gezogen hat.

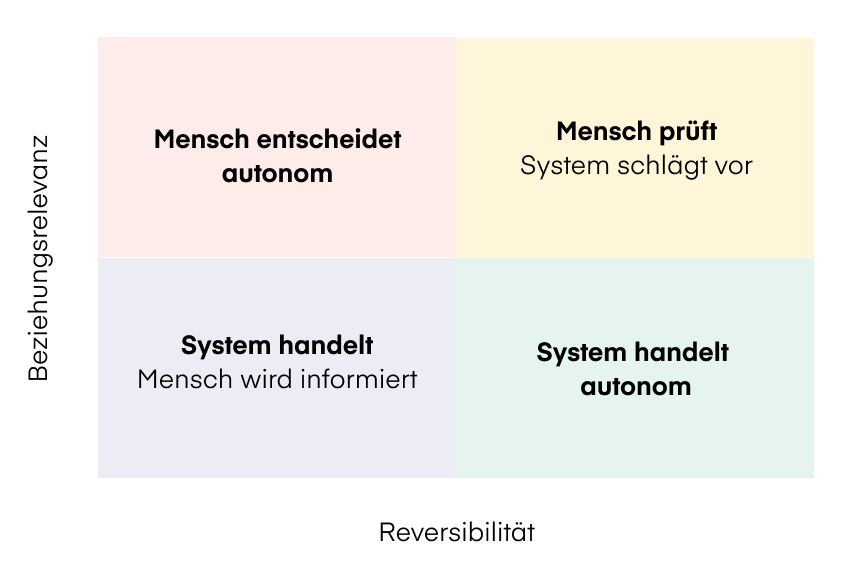

Eine Orientierung entlang zweier Achsen:

- Reversibilität: Kann die Entscheidung zurückgenommen werden? Eine ausgelöste E-Mail ist weg. Eine Stornierung hat Konsequenzen. Eine Preisanpassung erzeugt eine Erwartung.

- Beziehungsrelevanz: Berührt die Entscheidung Vertrauen, Loyalität oder das emotionale Erleben des Kunden?

Daraus entsteht ein einfacher Orientierungsrahmen:

- Hohe Beziehungsrelevanz + niedrige Reversibilität → Mensch entscheidet autonom

- Hohe Beziehungsrelevanz + hohe Reversibilität → Mensch prüft, System schlägt vor

- Niedrige Beziehungsrelevanz + niedrige Reversibilität → System handelt, Mensch wird informiert

- Niedrige Beziehungsrelevanz + hohe Reversibilität → System handelt autonom

Das Paketbeispiel vom Anfang landet klar im letzten Feld: standardisierter Prozess, hohe Reversibilität, geringes Beziehungsrisiko. Andere Entscheidungen – Kündigung, Reklamation, Kulanz bei Stammkunden – sind nicht dort.

Der europäische Kontext als Orientierungshilfe

Für Unternehmen in DACH kommt eine strukturelle Dimension hinzu: EU AI Act und DSGVO. Was manche als bürokratische Last wahrnehmen, hat für die Governance-Frage einen konkreten Wert: Er zwingt zur Explizitheit.

Der EU AI Act schreibt für Systeme, die Entscheidungen mit wesentlichem Einfluss auf Personen treffen, Transparenz, Nachvollziehbarkeit und menschliche Kontrollmechanismen vor. Unternehmen in DACH, die diese Anforderungen ernst nehmen, tun dabei etwas, das ohnehin notwendig wäre: Sie definieren explizit, welche Entscheidungen Systeme treffen dürfen – und welche nicht.

Wer die Guardrails-Frage im Rahmen des EU AI Act beantwortet, schafft dabei etwas, das über Compliance hinausgeht: eine kommunizierbare Grundlage für verantwortungsvolle Automatisierung.

Was das für CX-Verantwortliche bedeutet

Drei Fragen, die explizit beantwortet sein sollten – bevor das nächste System live geht:

- Was darf das System entscheiden – und was nicht? Vendor-Defaults sind Ausgangspunkte. Governance entsteht erst, wenn jemand bewusst entscheidet, was gilt – und was nicht.

- Wie wird sichtbar, wenn das System falsch liegt? Automatisierung ohne Feedback-Schleife hat kein Selbstkorrekturprinzip. Wer nicht prüft, skaliert Fehler.

- Wer trägt Verantwortung, wenn ein Automatismus zu einem Kundenproblem führt? Wenn die Antwort unklar ist, ist die Governance-Architektur noch nicht fertig.

Agentic AI ist eine reale Fähigkeit, die heute sinnvoll eingesetzt werden kann – in den richtigen Kontexten, mit der richtigen Aufsicht. Wo diese Grenzen verlaufen, ist eine unternehmerische Entscheidung. Und sie gehört zu CX.

Rainer Holler fasst es schlicht zusammen: „Ganz ohne Menschen geht es auch hier nicht.“ Das ist ein Designprinzip.

Systeme werden Entscheidungen treffen. Die Frage ist, ob wir als Organisationen die nötige Klarheit darüber entwickelt haben, welche das sein dürfen.